原标题:清华大学团队重大发现:人脸识别技术漏洞,15分钟解锁19个陌生智能国产手机

点击上图,查看详情

1

这起事件,如果用嘴简单的语言来形容就是:“ hello,你新买的手机不错呀,借我看看 ?”

所有功能、信息;任人宰割!!!

是不是超级不可思议???

看完下面的详细过程,你会更大吃一惊。 以下画面来源于:清华大学RealAI 团队的“ 勇敢爆料 ”,你们赶紧看看:

整个过程其实非常简单,清华大学的RealAI 团队共选取了 20 款手机,其中1款是国外的,另外19款都是我们国产的智能手机,居来自排名前五的国产手机品牌,每一品牌下选取了 3-4 款不同价位的手机型号,覆盖低端机到旗舰机 。

但是,接下来最精彩的部分来了。

第三步:将1号同学的照片,特别是眼睛部位。打印出来。贴在我们平时戴的眼镜上面。

然后,奇迹发生了。。。

19款国产智能手机,全部成功解锁。

从被破解的程度上看,攻击这些手机的难度几乎没有任何区别,不管是低端机,还是售价4000以上的高端手机,全都是秒级解锁。。。

啪的一下,全都自动解锁了!!!

那,这是不是巧合呢???

「这样的结果还挺出乎我们意料的,我们以为会需要多调优几次,但没想到这么容易就成功了。」—清华大学的RealAI团队 的算法人员表示自己都没想到。。。

结果,震惊了所有人!!几乎所有的测试,国产手机都是“ 秒开 ”!一下就被解锁了。。。

包括手机里的图片、视频、APP应用、甚至手机银行,全都能自由使用!!

一下子,清华大学彻底火了。今天,我们科技圈的各个同事,都被这条重大发现,懵逼了。。

虽然,我们之前就想过,人工智能技术,是一个新的技术,肯定会有不完整的地方。但,今天当有人真正爆出这一幕时,我们还是被震惊了。。

刚刚写稿前,清华大学RealAI研究团队对外还说了这样一段话:

「顺利解锁手机其实只是第一步,其实我们通过测试发现,手机上的很多应用,包括政务类、金融类的应用 APP,都可以通过对抗样本攻击来通过认证,甚至我们能够假冒机主在线上完成银行开户,下一步就是转账。」

2

《北京日报》前不久报道的这一起事件,不知道你们有没有印象:

某男子准备买房,于是去一家钟意的售楼处看房。看完后,男子对房子比较满意,于是询问价格。

包括向售楼处、也包括多次向不同的房产中介询问价格,优惠!!货比三家后,这个男子找了优惠最好的一家“ 正式买房 ”!!

男子非常疑惑!自己第一次去售楼处的时候,根本没有留下真实姓名和登记,怎么会有自己的信息??

问题其实就出在摄像头上面:

2、然后你的基本信息,就会被记录存档!

信息都被公开,任人看光??

3

再比如餐厅!

最近有网友反映,海底捞现在满餐厅都是摄像头。。随便一数就是几十个,上百个。。

如果只是为了防止客人“ 逃单 ”,“ 或者丢失物品 ”,那最多只需要3-5个摄像头就够了。有必要这样全场密密麻麻的装满摄像头吗??

并且,不知道大家有没有注意?现在你去商场里、超市里、甚至去一些路边走路,你都会发现,很多地方都被人装了好多好多的“ 摄像头 ”!!

如果只是为了防偷窃?那也太牛刀小试了,一个小小的超市,餐厅其实根本不需要如此重多的“ 高科技 ”啊。。

比如,刷脸坐高铁:

比如刷脸支付:

睁眼的也采集,闭眼的瞬间也采集。那万一碰到坏人,黑客,不法分子;一旦被利用,那后果将不敢想象。。

这不是危言耸听,这是真的!新华社都已经报道了:

叛卖真人照片!

《新华社》在10月底的时候,就已经报道了这样的事件。当时我都还没在意。

现在想想,我真的是“ 太天真 ”!!

写在最后:

但是,现在不一样了!!

当我们发现,原来所谓的智能手机,人脸解锁功能,就如同“ 皇帝的新衣 ”,如此简单,就能被破解的时候。

甚至,就连路边一个小小的火锅店、餐厅也能随便安装几十个,上百个摄像头,正大光明的拍照、记录我们的信息;

但,现在不一样了!

如果还放任不管,百分百必出大事!!

感谢清华大学!感谢贵校的人工智能研究团队 RealAI ,勇敢的站出来,将人工智能的巨大丑闻,公之于众!

那么新的攻击方式是如何实现的?

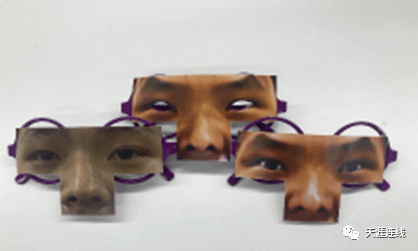

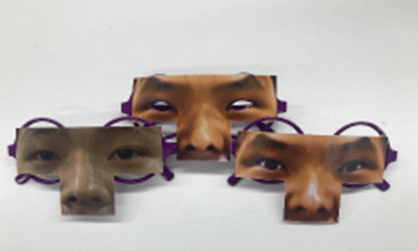

据介绍,RealAI 使用的整个破解过程物理上只用到三样东西:一台打印机、一张 A4 纸、一副眼镜框。

算法人员们介绍,他们在拿到被攻击者的照片后,通过算法在眼部区域生成干扰图案,然后打印出来裁剪为「眼镜」的形状贴到镜框上,测试人员戴上就可以实现破解,整个过程只花费 15 分钟左右。

左一为被攻击对象的眼部图像,右一、右二为生成的对抗样本图案。

与生成对抗网络 GAN 的对抗样本类似的是,「眼镜」上的花纹虽然很像复制了被攻击者的眼部图案,但其实并没有这么简单。算法人员表示,这是结合攻击者的图像与被攻击者的图像通过算法计算生成的扰动图案,在 AI 学界称为「对抗样本」。

将攻击者图像设定为输入值,被攻击者图像设定为输出值,算法会自动计算出最佳的对抗样本图案,保证两张图像相似度达到最高值。

看似粗糙的攻击手段,核心的对抗算法研发其实极具技术门槛。

但这也并不意味这一安全问题构不成威胁,RealAI 团队表示,「虽然开发出核心算法难度很大,但如果被黑客恶意开源的话,上手难度就大大降低了,剩下的工作就只是找张照片。」言外之意就是,只要能拿到被攻击对象的 1 张照片,大部分人都能很快制作出犯罪工具实现破解。

对抗样本攻击,从实验室走进现实

对抗样本攻击的概念其实并不新颖,2013 年,Google 研究员 Szegedy 等人发现机器学习容易遭受欺骗,通过故意在数据源上添加细微扰动,就可以让机器学习模型作出错误输出,对抗样本攻击也被视为 AI 安全领域的一大隐忧。

在某些神经网络中,这张图像被认为是熊猫的置信度是 57.7%,且其被分类为熊猫类别的置信度是所有类别中最高的,因此网络得出一个结论:图像中有一只熊猫。但是,只需要添加少量精心构造的噪声,可以得到一个这样的图像(右图):对于人类而言,它和左图几乎一模一样,但是网络却认为其被分类为「长臂猿」的置信度高达 99.3%。

信息安全的本质是攻防,AI 安全领域也是如此。科学家们通过不断开展新的攻击尝试来试探对抗样本攻击的能力边界。

近年来,我们看到了 AI 研究者们展示的各种攻击方式:让图像识别算法将 3D 打印乌龟认作步枪,攻击目标检测系统让人体实现「隐身」,破解物体识别检测器让自动驾驶错误识别停车标志…

但技术的发展存在一个过程,很多在实验环境下开展的攻击研究经常被证明并不稳定,难以走出实验室,无法带来明显的安全隐患。

包括 2019 年 8 月份,来自莫斯科国立大学、华为莫斯科研究中心的研究者们曾发布,在脑门上贴一张对抗样本图案,能让公开的 Face ID 系统识别出错,这虽然被视为 AI 算法首次在现实世界中实现攻击,但攻击对象仍是公开版的识别系统,其安全性、复杂性与真正商用系统仍有很大差距。

RealAI 团队本次实现的攻击却真正打破了「难以复现」的情况,一方面证实了对抗样本攻击的切实威胁,一方面也印证了人脸识别这项数千万人都在使用的应用技术正面临全新的安全挑战。

近年来,关于人脸识别的争议一直存在,此前也陆续曝光过「一张打印照片就能代替真人刷脸」、「利用视频欺骗人脸身份认证」、「打印 3D 模破解手机人脸解锁」等等安全事件。

不过,RealAI 算法人员表示,目前市面上常见的攻击手段以「假体攻击」为主,比如照片、动态视频、3D 头模或面具,识别终端采集的仍然是机主本人的图像素材,主要难点在于攻破动态检测,不过这类攻击目前已经很容易被防范——2014 年防假体标准推出,让业界主流算都搭载了活体检测能力。

随后业内又出现了网络攻击方法,通过劫持摄像头来绕过活体检测。但对抗样本攻击完全不受活体检测限制,是针对识别算法模型的攻击,终端采集到的是攻击者的图像,通过活体检测后,因为添加了局部扰动,识别算法发生了错误识别。

「对于人脸识别应用来说,这是一个此前未曾出现的攻击方式,」RealAI 算法人员解释道。「如果把人脸识别比喻成一间屋子,每一个漏洞的出现就相当于屋子里面多个没关严的窗户,活体检测等安全认证技术相当于一把把锁。对于厂商来说,他们或许以为这间屋子已经关严实了,但对抗样本的出现无疑是另一扇窗,而此前完全没有被发现,这是一个新的攻击面。」

我们能防御这种攻击吗?

在人脸识别应用泛滥的今天,人脸识别与个人隐私、个人身份、个人财产等等因素都息息相关,这个口子一旦被撕开,连锁反应就被打开。

RealAI 表示,现有的人脸识别技术可靠度远远不够,一方面受制于技术成熟度,另一方面受至于技术提供方与应用方的不重视。「顺利解锁手机只是第一步,其实我们通过测试发现,手机上的很多应用,包括政务类、金融类的应用 APP,都可以通过对抗样本攻击来通过认证,甚至我们能够假冒机主在线上完成银行开户,下一步就是转账。」

未来是否会有专门的产品与技术来应对对抗样本攻击?RealAI 的回复是,这是一定的。而且他们目前已开发了相应的防御算法能够协助手机厂商进行升级。

「所有的攻击研究,最终的目标还都是为了找出漏洞,然后再去针对性地打补丁、做防御。」

「所有的攻击研究,最终的目标还都是为了找出漏洞,然后再去针对性地打补丁、做防御。」

在这一方面,RealAI 去年推出了人工智能安全平台 RealSafe。他们将这款产品定义为 AI 系统的杀毒软件与防火墙系统,主要就是针对人脸识别等应用级 AI 系统做防御升级,帮助抵御对抗样本攻击等安全风险。

对于人脸识别技术的提供方,基于这一平台,可以低成本快速实现安全迭代;对于人脸识别技术的应用方,可以通过这一平台对已经落地的系统应用进行安全升级,也可以在未来的产品采购,加强对人脸识别技术、相关信息系统和终端设备的安全性检测。

但人脸识别技术引发的担忧远不止于此,除了技术侧的解决方案之外, 最终填补漏洞还需要依赖社会对于人工智能安全问题的意识提升。